Elastic Stack

【杭州站】Elastic & 阿里云 Meetup 6月5号

活动 • liaosy 发表了文章 • 0 个评论 • 2646 次浏览 • 2021-05-22 17:38

活动介绍

本次Meetup杭州站由阿里云和Elastic联合举办,邀请来自滴滴、安恒信息、阿里云的资深技术专家探讨在搜索、安全、内核优化等方向的实践与创新,以及发布由数十位优秀技术开发者共创而成的实战指南,共同分享 Elasticsearch技术大咖的一线经验与深度思考。

报名方式

链接:https://www.bagevent.com/event/7449056

扫码:

活动时间

2021年06月05日 13:00-17:30

活动地址

浙江省杭州市余杭区阿里巴巴西溪园区访客中心 206-S越秀书院

活动流程

13:00~13:15 签到入座

13:15~13:30 开发者共创书籍《Elastic Stack 实战手册V1.0》发布

13:30~14:30 滴滴Elasticsearch内核优化之路

韩宝君 滴滴Elasticsearch资深开发工程师/ES社区Contributor

14:30~15:30 Elasticsearch在SIEM的应用与实践

汤乐奇 安恒信息AiLPHA大数据资深研发经理

15:30~16:30 Elasticsearch Serverless 云原生时代的创新实践

马华标(城破) 阿里巴巴高级技术专家/阿里云ES内核研发负责人

16:30~17:20 圆桌交流

17:20~17:30 抽奖合影活动奖品

阿里云双肩包、T恤、Elastic定制礼物

阿里云ACE

阿里云ACE即全称 Alibaba Cloud Engineer,是意为阿里云的工程师、代表着云计算的建设者。同时“ACE”又是扑克牌中的“A”,因此阿里云ACE也寓意着是云计算领域王牌的一群人。在线上,ACE拥有专属的页面和29个社群,承载论坛及专栏等内容; 在线下,ACE通过组织丰富的活动,包括技术沙龙、TechDay、Meetup、官方互动等来形成本地化的开发者的学习、社交平台。

通过ACE组织的各种活动,ACE用户可以结识本地的开发者,收获前沿知识,积累行业经验,并加深对阿里云的了解。

活动交流及杭州ACE同城会钉群

活动海报

2021 Elastic 中文社区深圳线下 Meetup 重磅重启,讲师招募进行中!

活动 • howardhuang 发表了文章 • 0 个评论 • 2639 次浏览 • 2021-05-21 15:49

Docker如何快速构建Elastic Stack

Elasticsearch • zqc0512 回复了问题 • 3 人关注 • 2 个回复 • 2444 次浏览 • 2019-01-17 11:40

访谈:Elastic Stack v6.5 新特性解读

Podcast • medcl 发表了文章 • 0 个评论 • 3038 次浏览 • 2018-11-25 21:23

欢迎来到 Elastic 社区电台的第八期节目,我们本期节目的嘉宾是来自于Elastic 在中国的首席架构师吴斌, Elastic 在本月11月14日发布了一个全新的版本 6.5,放出了一系列精彩的特性,本次节目我们就这些最近发布的新特性做一个简单的解读。

收听地址

https://www.ximalaya.com/keji/14965410/139462151

嘉宾

吴斌,十年 IT 行业经验,经历了软件工程师到架构师的全方位磨练。专注于海量数据处理、挖掘、分析和企业级搜索等领域。 现任 Elastic 架构师,负责公司亚太地区事务。致力于应用 Elastic 的先进技术产品解决企业数据应用问题。

主持人

Elastic 技术布道师,曾勇(Medcl)。

关于 Elastic 社区电台

Elastic 开源社区举办的一款播客类节目, 邀请来自开源社区的用户,一起聊聊 Elastic 开源产品的使用案例、经验分享、架构变迁等等。

Elastic Stack 6.0 发布 beta 版本啦!

资讯动态 • medcl 发表了文章 • 11 个评论 • 5965 次浏览 • 2017-08-09 10:29

- Sequence numbers and fast recovery

- Search scalability

- Preventing full disks

- Removal of default passwords

- 优化 Profiling 的开销占用,进一步较少针对超时及查询取消的检查开销

- 提升 Percolator 的性能

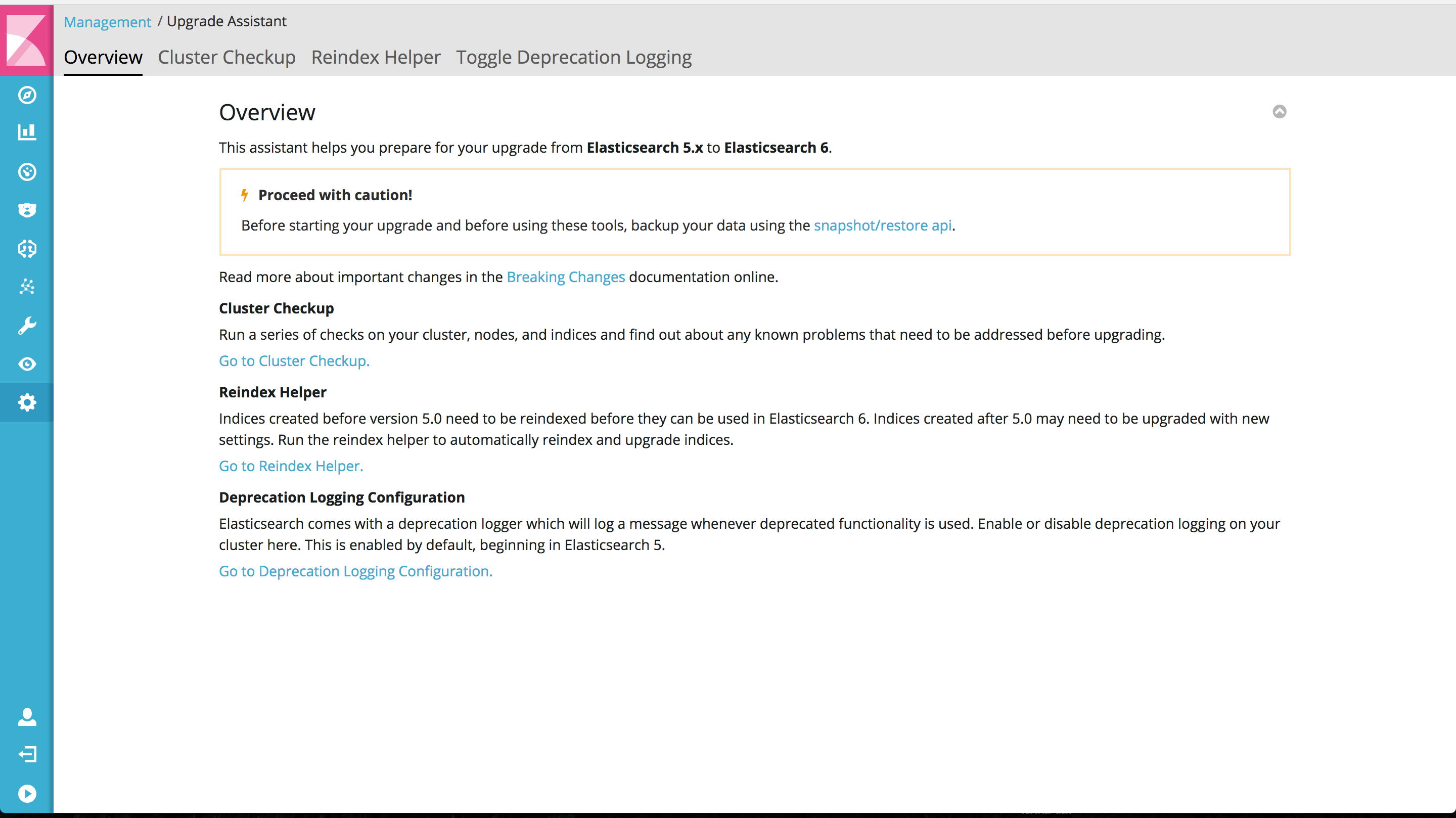

- Upgrade Assistant and Rolling Upgrade Support

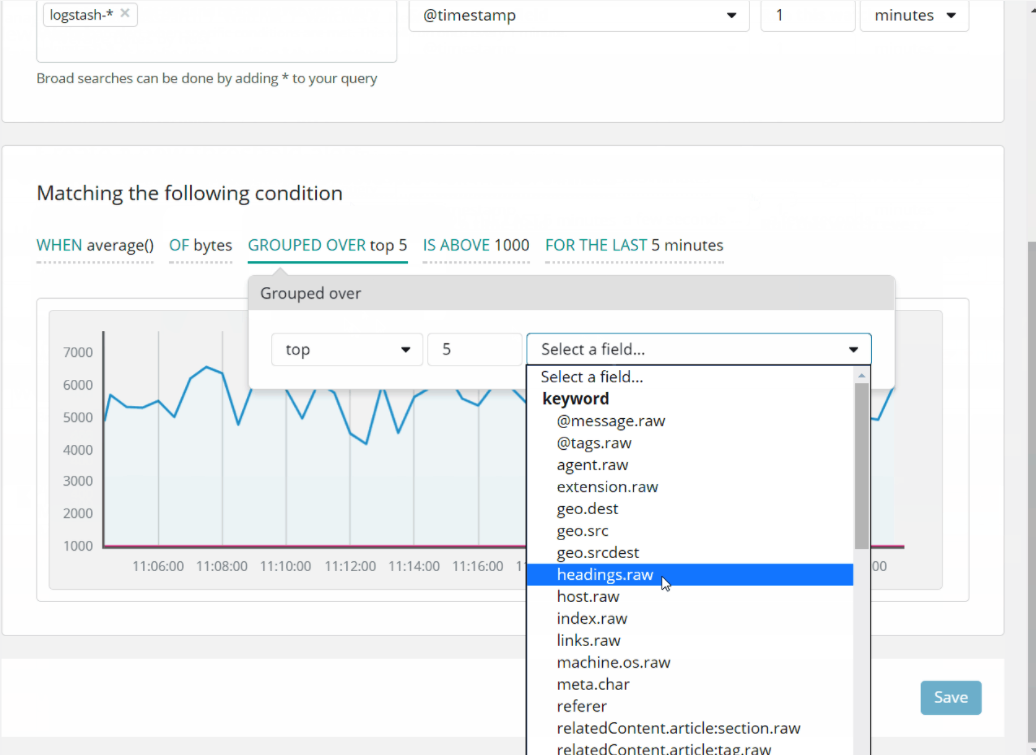

- Watcher UI for Threshold Based Alerts

- Experimental Kibana Query Language

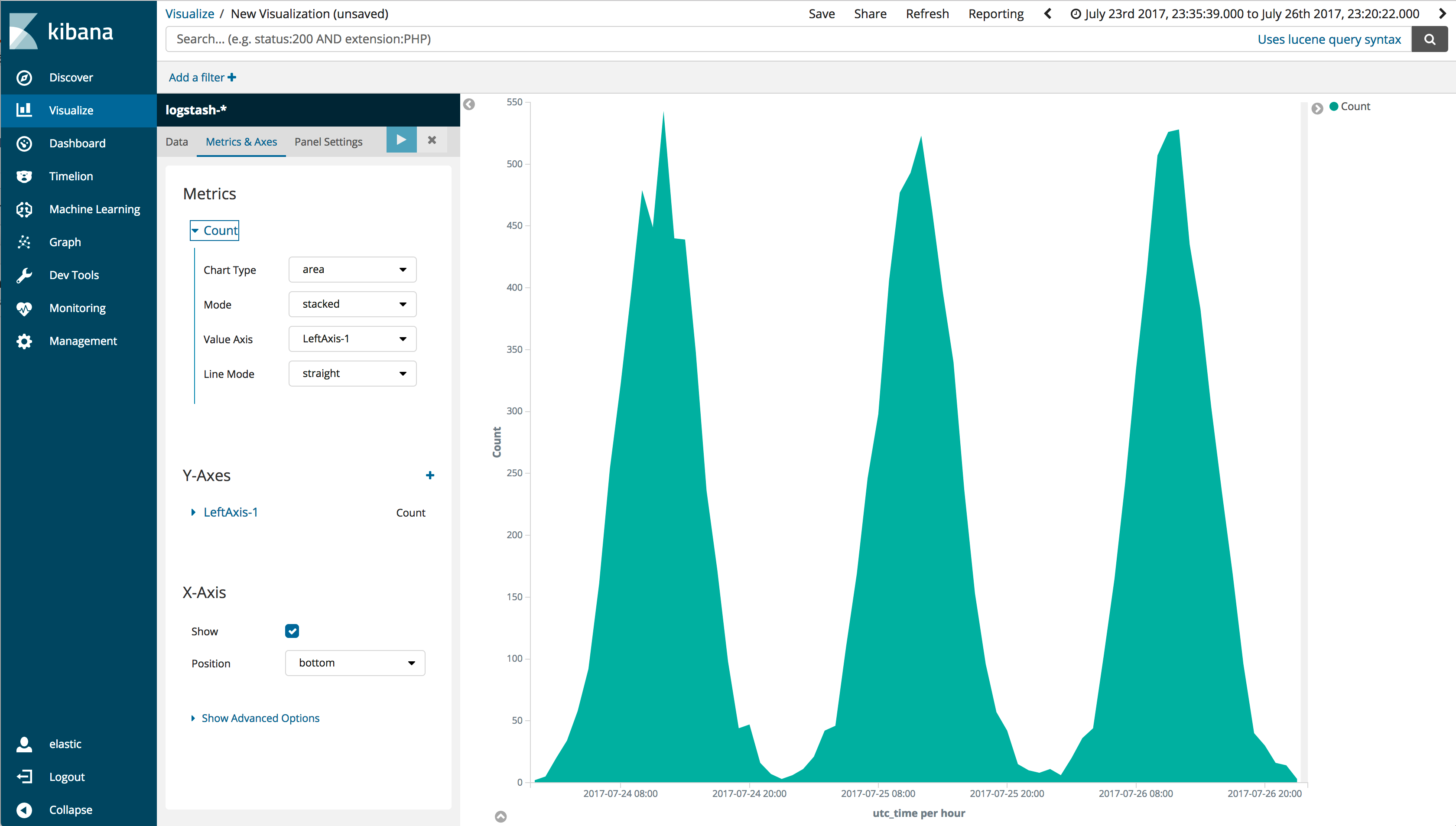

- Refactoring of the Visualizations Code

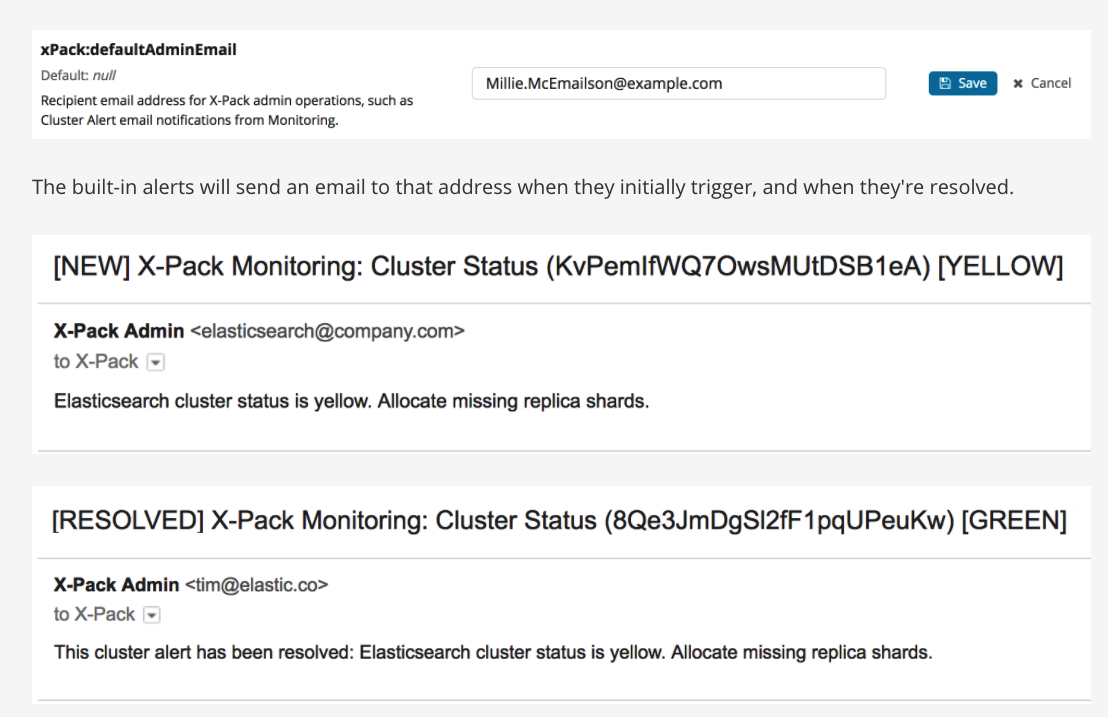

- X-Pack Monitoring Email Notifications for Cluster Alerts

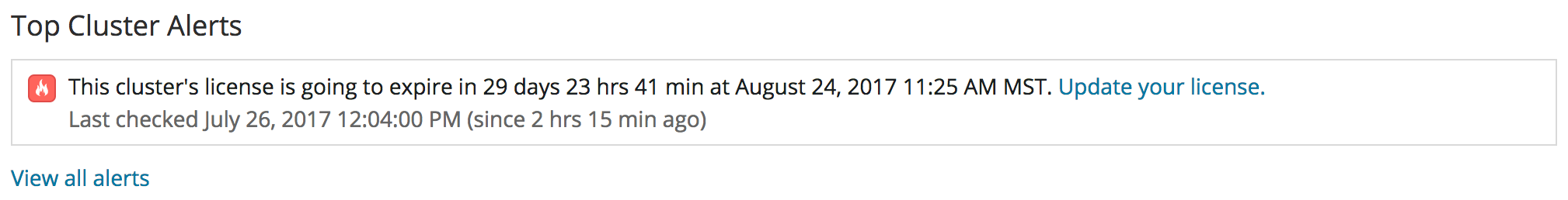

- Cluster Alert for X-Pack License Expiration

- New Colors to Improve Accessibility

- Full Screen Mode for Dashboard

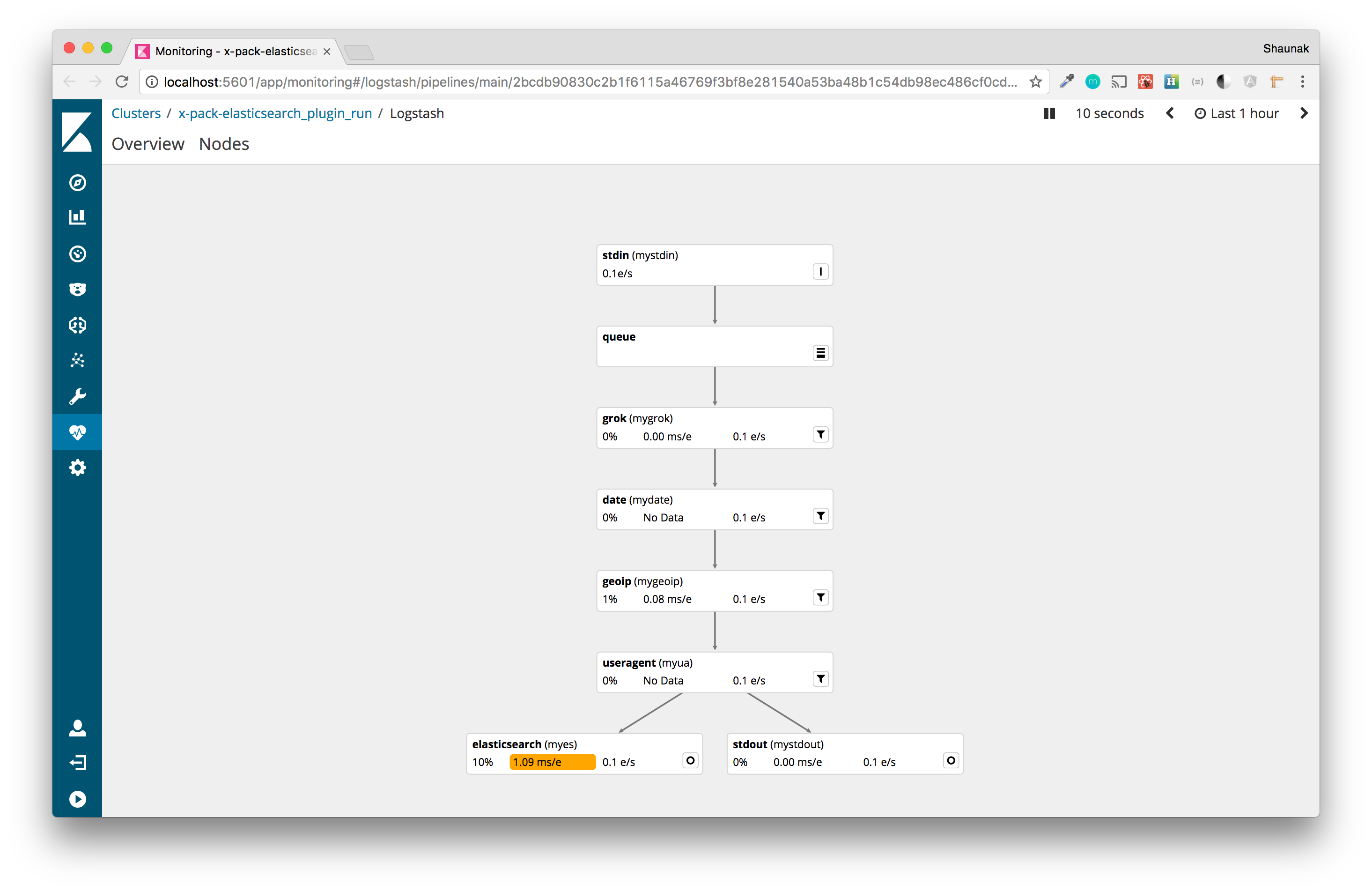

- Pipeline Viewer

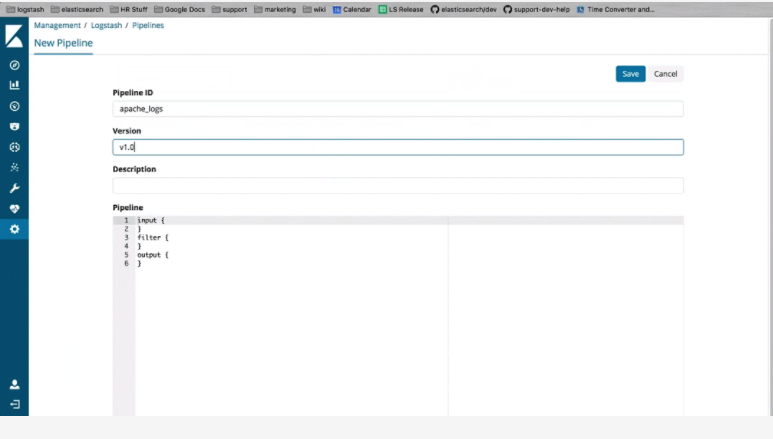

- Centrally manage configurations

- Ingest to Logstash convertor

$LS_HOME/bin/ingest-convert.sh --input file:///tmp/ingest/apache.json --output file:///tmp/ingest/apache.conf

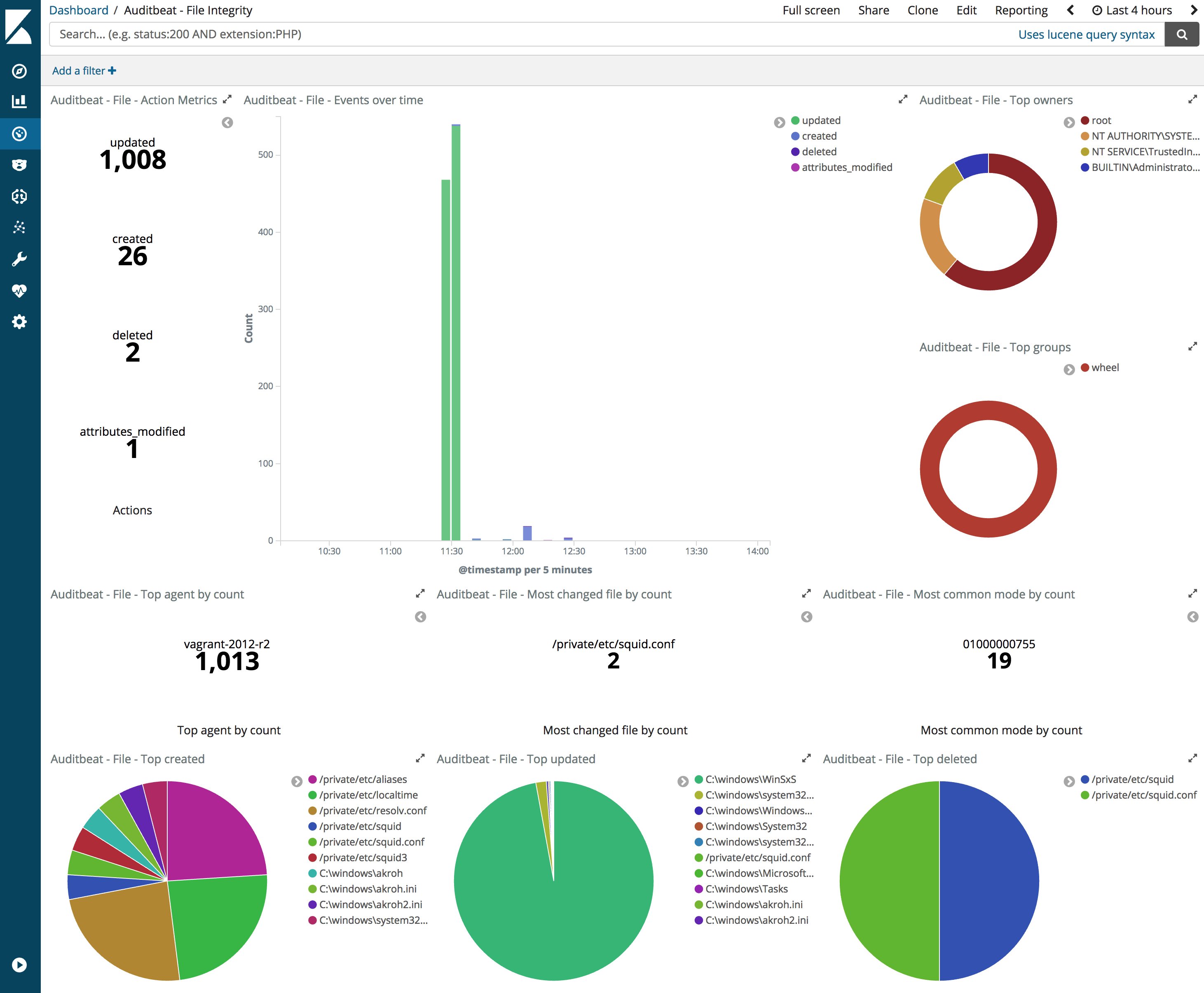

- Auditbeat

- New commands and configuration layout

$ metricbeat modules list

$ metricbeat modules enable redis

$ metricbeat modules disable redis- Add Docker metadata to the Docker logs

- Internal pipeline refactoring

- Spark 2.2.0 and Stable Support for Spark Structured Streaming

- Support for new Join Fields

- Multiple Mappings and Multiple Index Reads

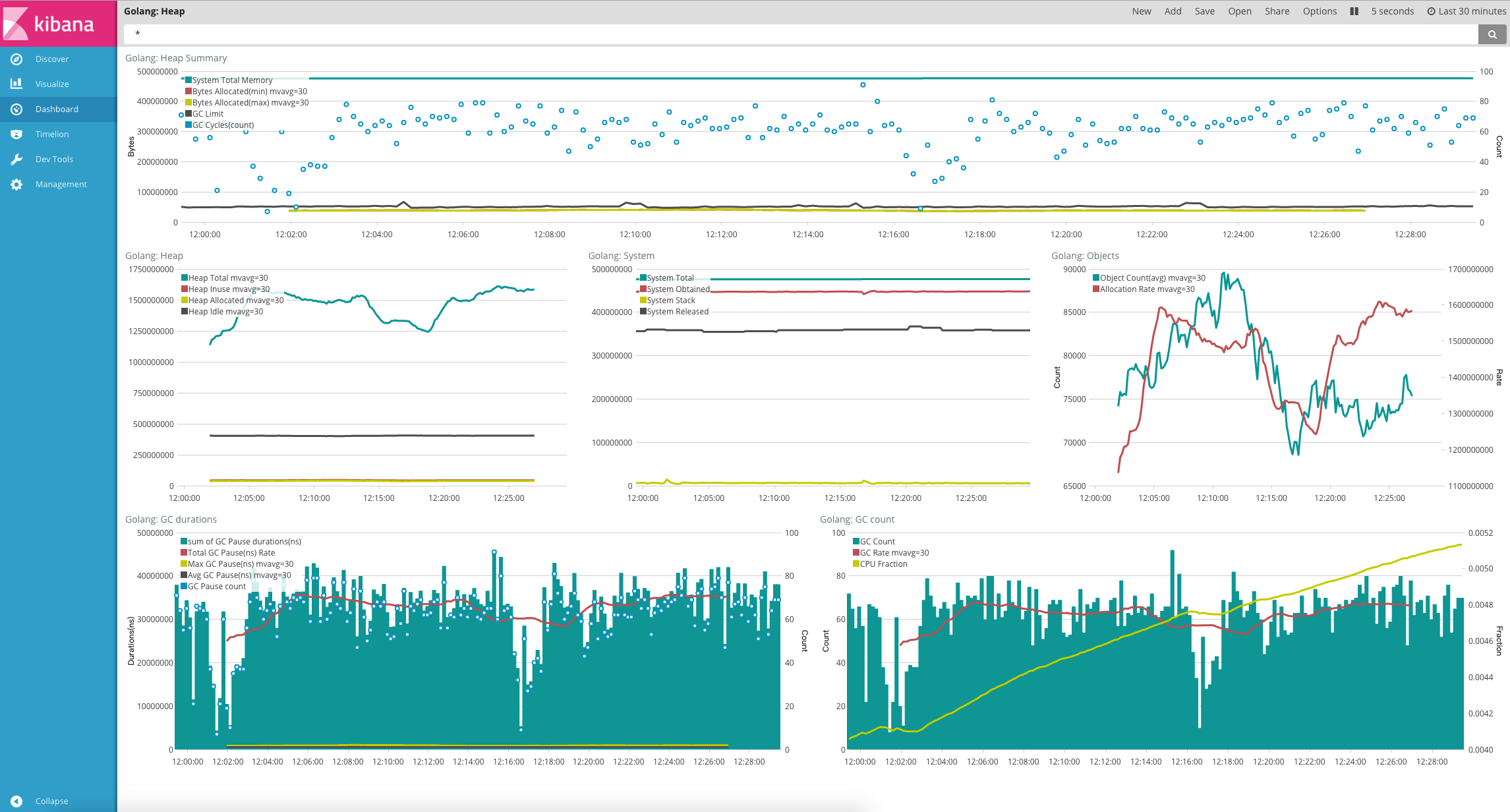

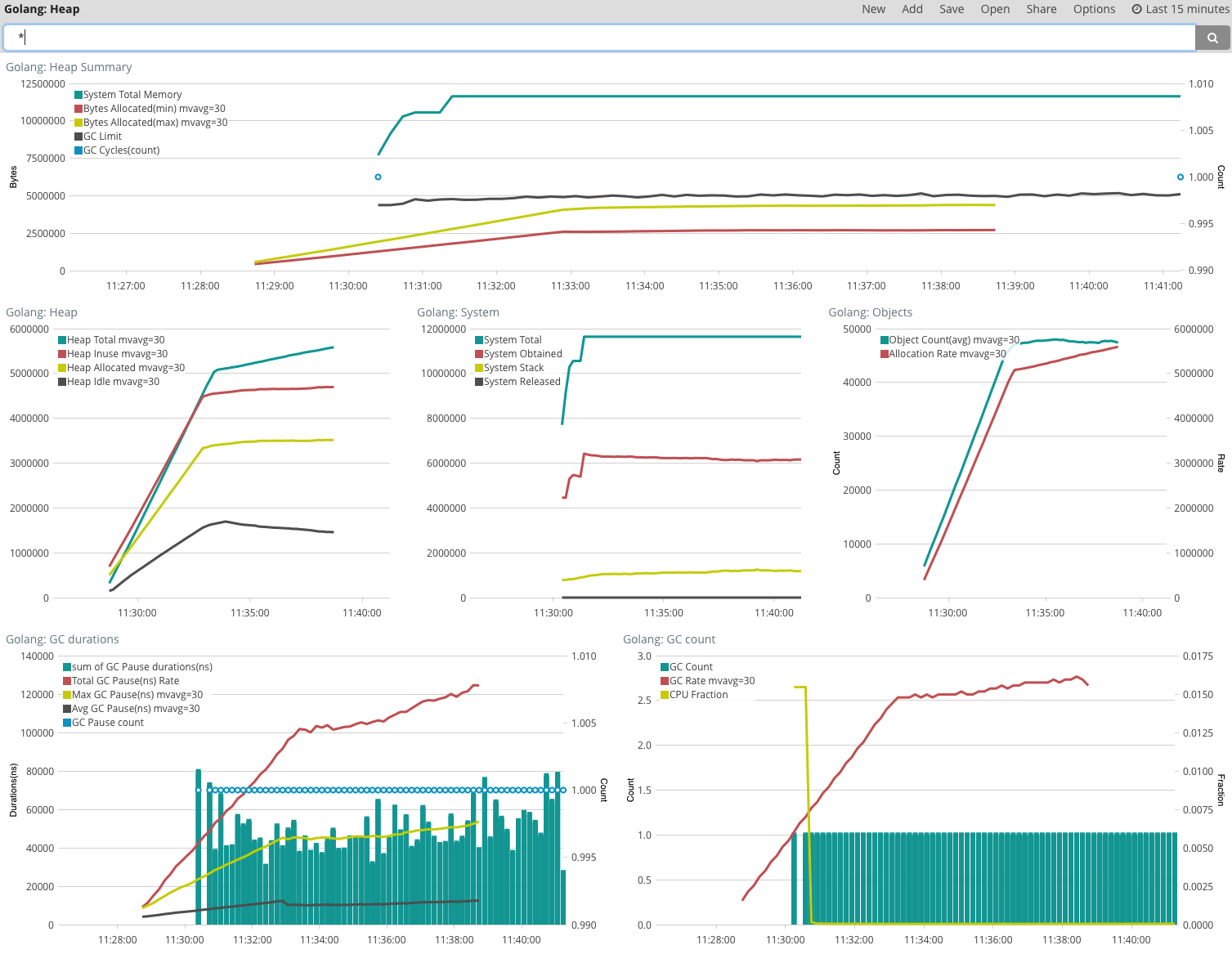

使用 Elastic Stack 来监控和调优 Golang 应用程序

Beats • medcl 发表了文章 • 0 个评论 • 11567 次浏览 • 2017-03-03 11:16

- Apache Module

- Couchbase Module

- Docker Module

- HAProxy Module

- kafka Module

- MongoDB Module

- MySQL Module

- Nginx Module

- PostgreSQL Module

- Prometheus Module

- Redis Module

- System Module

- ZooKeeper Module

import _ "expvar"func metricsHandler(w http.ResponseWriter, r *http.Request) {

w.Header().Set("Content-Type", "application/json; charset=utf-8")

first := true

report := func(key string, value interface{}) {

if !first {

fmt.Fprintf(w, ",\n")

}

first = false

if str, ok := value.(string); ok {

fmt.Fprintf(w, "%q: %q", key, str)

} else {

fmt.Fprintf(w, "%q: %v", key, value)

}

}

fmt.Fprintf(w, "{\n")

expvar.Do(func(kv expvar.KeyValue) {

report(kv.Key, kv.Value)

})

fmt.Fprintf(w, "\n}\n")

}

func main() {

mux := http.NewServeMux()

mux.HandleFunc("/debug/vars", metricsHandler)

endpoint := http.ListenAndServe("localhost:6060", mux)

}metricbeat.modules:

- module: golang

metricsets: ["heap"]

enabled: true

period: 10s

hosts: ["localhost:6060"]

heap.path: "/debug/vars"output.elasticsearch:

hosts: ["localhost:9200"]./metricbeat -e -vvar inerInt int64 = 1024

pubInt := expvar.NewInt("your_metric_key")

pubInt.Set(inerInt)

pubInt.Add(2)./metricbeat -httpprof="127.0.0.1:6060" -e -v{

"output.events.acked": 1088,

"output.write.bytes": 1027455,

"output.write.errors": 0,

"output.messages.dropped": 0,

"output.elasticsearch.publishEvents.call.count": 24,

"output.elasticsearch.read.bytes": 12215,

"output.elasticsearch.read.errors": 0,

"output.elasticsearch.write.bytes": 1027455,

"output.elasticsearch.write.errors": 0,

"output.elasticsearch.events.acked": 1088,

"output.elasticsearch.events.not_acked": 0,

"output.kafka.events.acked": 0,

"output.kafka.events.not_acked": 0,

"output.kafka.publishEvents.call.count": 0,

"output.logstash.write.errors": 0,

"output.logstash.write.bytes": 0,

"output.logstash.events.acked": 0,

"output.logstash.events.not_acked": 0,

"output.logstash.publishEvents.call.count": 0,

"output.logstash.read.bytes": 0,

"output.logstash.read.errors": 0,

"output.redis.events.acked": 0,

"output.redis.events.not_acked": 0,

"output.redis.read.bytes": 0,

"output.redis.read.errors": 0,

"output.redis.write.bytes": 0,

"output.redis.write.errors": 0,

"beat.memstats.memory_total": 155721720,

"beat.memstats.memory_alloc": 3632728,

"beat.memstats.gc_next": 6052800,

"cmdline": ["./metricbeat","-httpprof=127.0.0.1:6060","-e","-v"],

"fetches": {"system-cpu": {"events": 4, "failures": 0, "success": 4}, "system-filesystem": {"events": 20, "failures": 0, "success": 4}, "system-fsstat": {"events": 4, "failures": 0, "success": 4}, "system-load": {"events": 4, "failures": 0, "success": 4}, "system-memory": {"events": 4, "failures": 0, "success": 4}, "system-network": {"events": 44, "failures": 0, "success": 4}, "system-process": {"events": 1008, "failures": 0, "success": 4}},

"libbeat.config.module.running": 0,

"libbeat.config.module.starts": 0,

"libbeat.config.module.stops": 0,

"libbeat.config.reloads": 0,

"memstats": {"Alloc":3637704,"TotalAlloc":155

... ...- module: golang

metricsets: ["heap","expvar"]

enabled: true

period: 1s

hosts: ["localhost:6060"]

heap.path: "/debug/vars"

expvar:

namespace: "metricbeat"

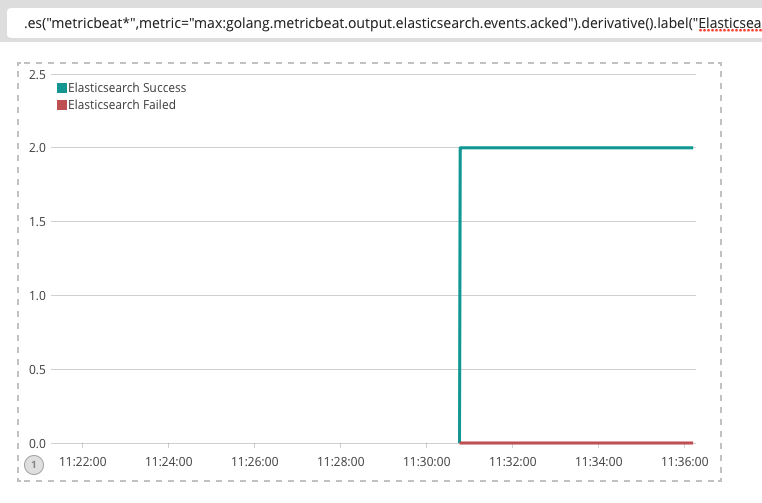

path: "/debug/vars".es("metricbeat*",metric="max:golang.metricbeat.output.elasticsearch.events.acked").derivative().label("Elasticsearch Success"),.es("metricbeat*",metric="max:golang.metricbeat.output.elasticsearch.events.not_acked").derivative().label("Elasticsearch Failed")Elastic Stack 5.2.2 发布

资讯动态 • medcl 发表了文章 • 5 个评论 • 3373 次浏览 • 2017-03-01 10:37

- 修复request熔断器没有正确处理当前运行请求数的bug,当请求返回前却被客户端关闭时没有对计数减一,会造成节点慢慢的不能处理任何请求,除非重启节点,所有的用户都应该升级 #23317

- 修复cgroup正则解析的bug,造成节点的不能正常启动 #23219

- 被shard锁暂缓执行的请求可能会别其他线程启动,并且该请求丢失了上下文,会造成该请求被当做非法请求而拒绝

- 恢复terms agg的include/exclude参数的支持

- 修复持久化队列在windows启用造成的崩溃

- 修复多实例公用相同的数据目录造成的数据损坏

- 修复JVM性能指标收集造成的吞吐影响

- 之前的版本kibana的visualization依赖一个旧的Elasticsearch的include/exclude特性,但是该功能在Elasticsearch5.2.1被突然移除了,引起了kibana的visualization的错误,现在Kibana对新创建的visualization使用正确的结构,并且能在查询时自动转换遗留的旧结构到新的结构

- 从5.2.0开始,包含sub-bucket的垂直条形图(vertical bar)配置为分组没有合适的缩减y轴,造成相当小甚至某些情况下不可用,这次回归将再次对y轴进行必要的扩展而不管其条形图的模式

- Metricbeat修复当docker容器被kill掉造成的docker 模块挂起的bug

- Metricbeat修复超时时间设置而不是默认值

Elastic Stack 5.2.1 发布

资讯动态 • medcl 发表了文章 • 4 个评论 • 5529 次浏览 • 2017-02-15 14:07

- 当存储字段配置为“best_compression",我们依赖于 JVM 回收机制来释放解压缩实例(Deflater/Inflater instances)。然而这些类也行只使用了很少的 JVM 堆栈内存,却使用了大量了本地内存,所以可能 会出现在 JVM 回收解压缩实例之前而操作系统先用完了本地内存。 LUCENE-7647。

- 特定的查询可能会持有 IndexReader 的一个引用,当这些查询被缓存之后,本来应该已经被删除的段会因为这个引用而继续被 Lucene 持有。LUCENE-7657。

- Geo distance range 废弃,请使用`geo_distance` bucket aggregation 或 geo_distance sort来替代。#22835。

- 分配解释 API(allocation explaining)在未分配主分片信息中包含陈旧的副本信息(不管是陈旧还是损坏的)#22826。

- 如果查询超时,将缓存结果置为无效。#22807。

- Reindex 接口支持来源 es 版本<2.0,当不能清除旧的 scroll 不记录日志。

- 将参数:search.highlight.term_vector_multi_value 保留为节点级别。

Elastic Stack 5.2.0 发布

资讯动态 • medcl 发表了文章 • 1 个评论 • 6988 次浏览 • 2017-02-03 13:26

- 新增数字和日期范围字段类型,非常方便对范围类型进行交并集的查询,比如你的数据是日历类型的数据,每天都有一些会议信息,会议的开始和结束时间都不同,你想看本周那天有空,可以使用 range fields 很方便的进行查询。了解更多

- 新增分片分配解释 API,会告知分片失败的具体原因,如分片损坏、磁盘写满还是配置错误,进行快速运维,以前只能根据经验到处寻找可能是什么问题,费事费力,了解更多。

- 对 Keyword 类型标准化,在5.0将 string 类型拆成了 text 和 keyword两种类型,text 支持分词,keyword 则不分词默认支持 doc values,不过有时候你还需要对 keyword 类型进行一些标准化处理,如都转成小写,现在可以使用 normalizers 参数来指定标准化的 filter。

- Terms 聚合的分区,terms 聚合默认返回10个 term,以前如果你需要返回全部的 term 列表是不可能的任务(基于内存压力),现在你可以通过将请求分区,以多次请求的方式来取回这些数据,了解更多。

- 字段折叠,在搜索时可以按某个字段的值进行折叠,在每个折叠的值内进行排序选取 topN,了解更多。

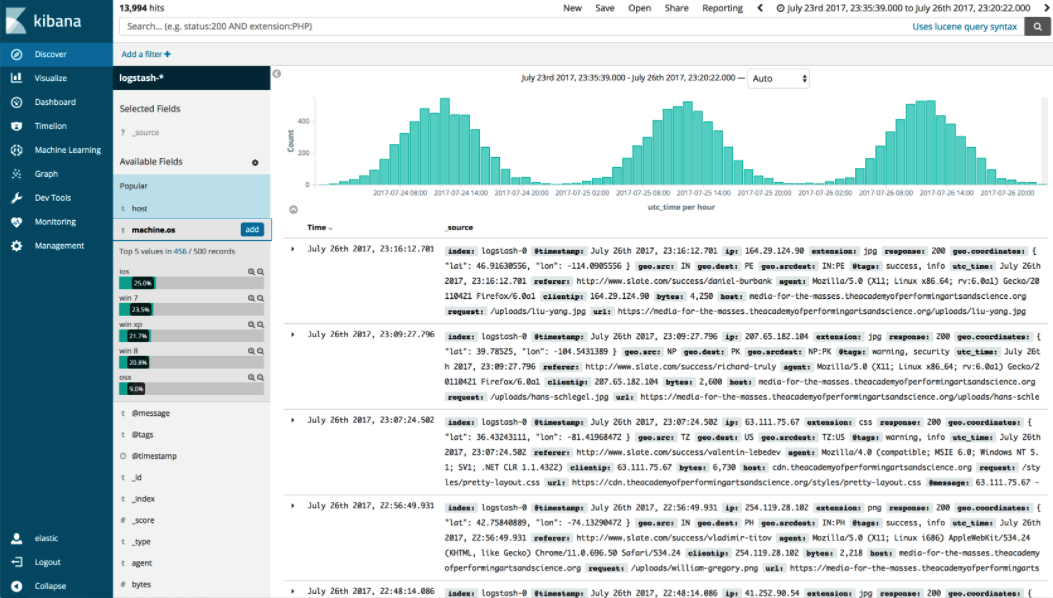

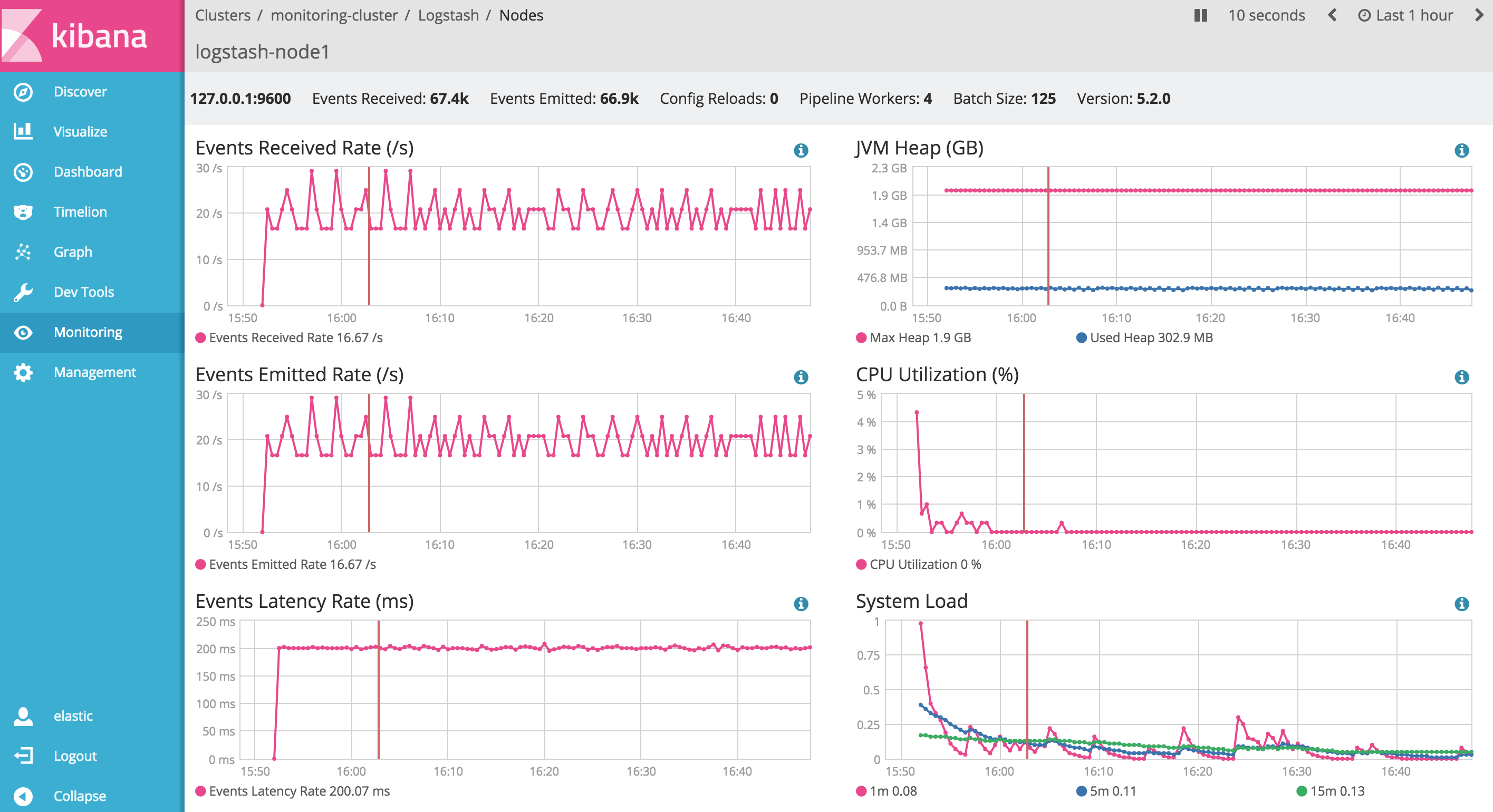

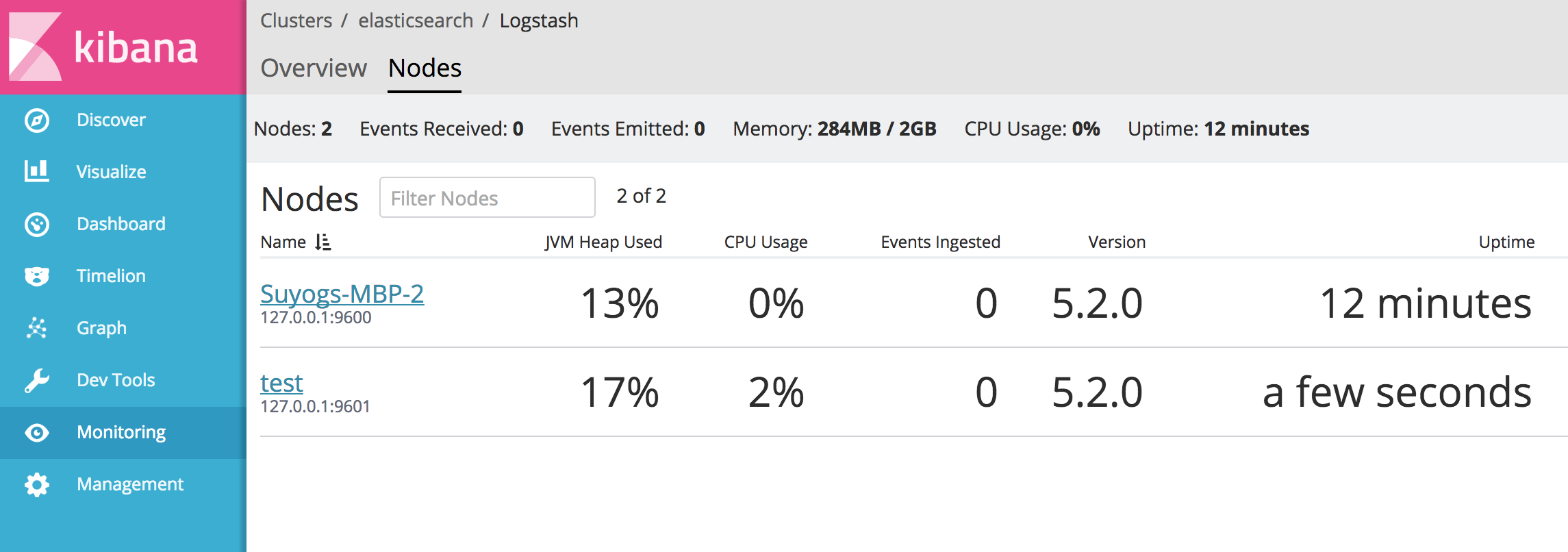

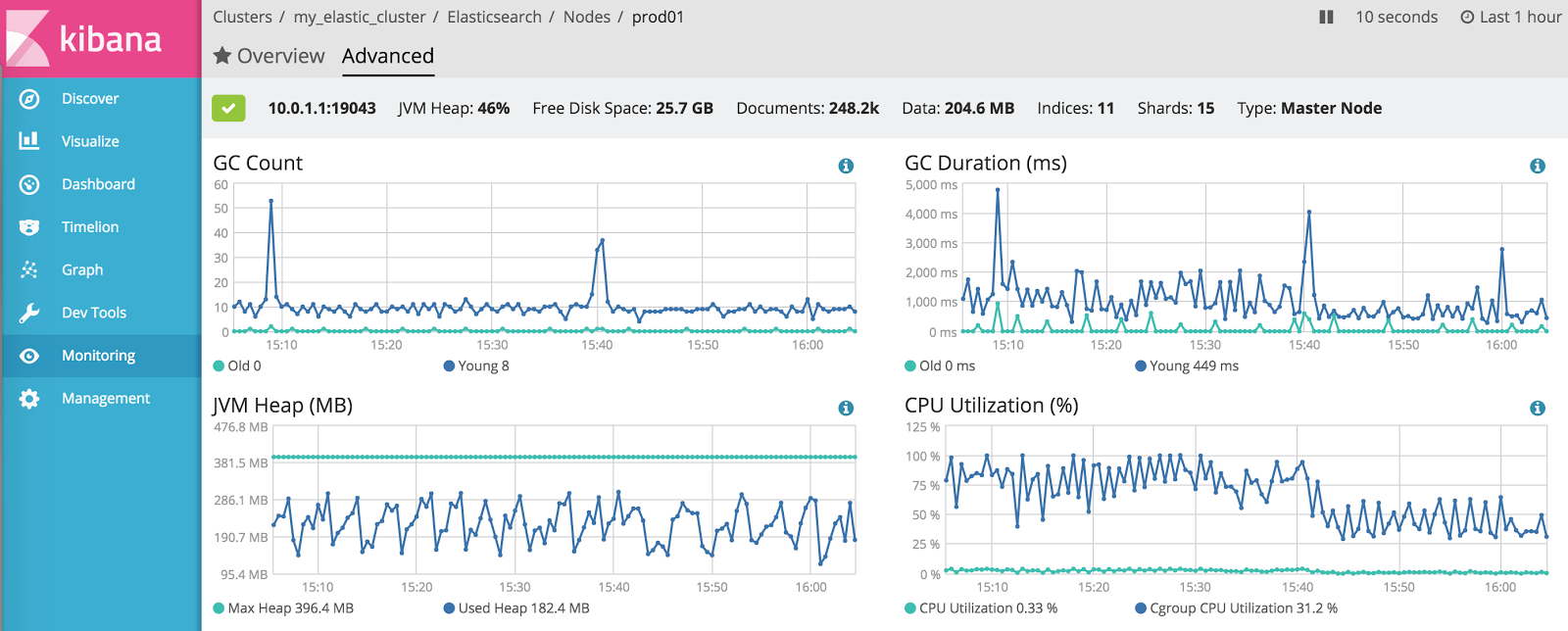

- 新的监控 UI,现在 X-Pack 也能监控 logstash 了,X-Pack 基础免费版就包括,如下图:

- 更多的监控 API,新增3个类型的统计信息:cgroup、持久化队列和 output新增持续时间字段。

- 离线插件管理,在很多没有公网的部署环境,都需要离线安装,以前的离线安装不够完善,尽管大部分插件没问题,但是还是存在个别插件的依赖链下载不完整的问题,为了解决这个问题,我们基本上重新设计了整个工作流程使用了新的方式来打包插件和他所有的依赖,了解更多。

- 支持 Elasticsearch Tribe 节点,在“admin”集群的基础上,引入了新的“data”集群,“data”集群可以理解成 Kibana 后面的数据来源,可以是 tribe 节点,而“admin”集群是存放 kibana 可视化信息“。kibana”索引的地方,默认 data 和 admin 集群都是在同一个集群,且不能是 tribe 节点,目前还有一些细节正在处理,如 console 还不能很好的工作。

- 增加新的可视化类型:热点图(heatmap),可以很方便的按区间和按时间来显示数据的范围分布,如下图:

- 开始进行国际化的支持,感谢 IBM 团队的努力,目前已经提供了基础的框架支持,虽然是万里长征的第一大步,但也是非常激动人心的。

- 地图服务的改进,Elastic 自己的 Tile 地图服务已经上线几个月了,我们现在能提供10个级别的缩放了,X-Pack 基础用户可以达到12个级别的缩放,并且我们正在尝试18个级别的缩放,并且从5.2开始,我们能让这些级别动态调整,不用发布新的 Kibana。

- 监控容器中的 Elasticsearch,现在我们可以监控容器里面的 Elasticsearch 实例的运行情况了,CPU 利用率、GC、堆栈使用情况等,如下图:

- 新增 Beat:Heartbeat,一个新的正式的官方beat 成员,用于可用性监控,和所有的 beat 一样,轻量级,Heartbeat 可以用于很多场景,比如安全,你不希望暴露某个端口时,使用 Heartbeat,当你发现该端口对外开启了,就可以触发通知,或者服务/网站可用性检测,服务down 了可以及时感知,目前支持:ICMP、TCP 和 HTTP 类型的监控,目前 Heartbeat还处于 beat 阶段,暂不推荐用于生产环境。

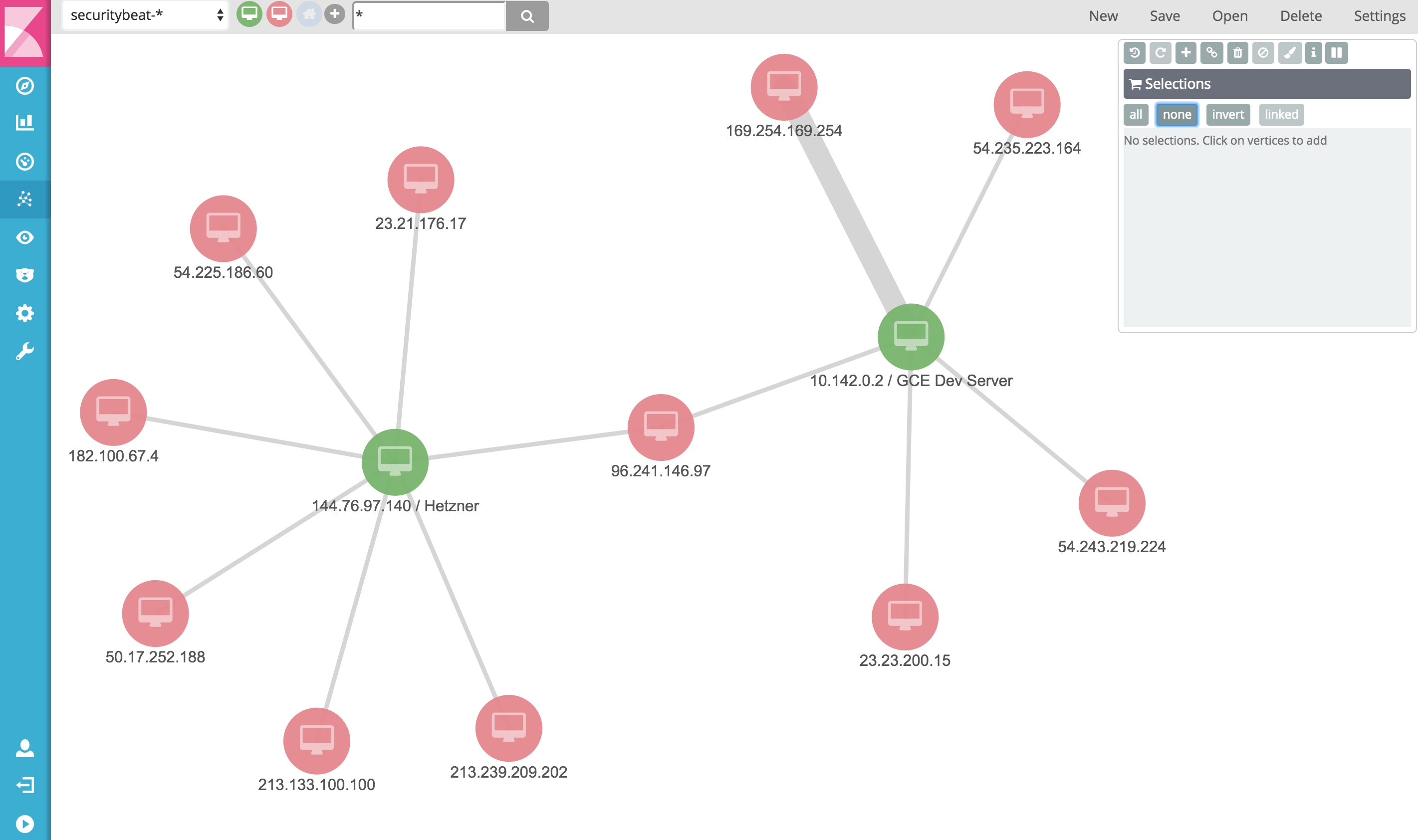

- Metricbeat 可跟踪网络连接,从5.2开始,Metricbeat 导出了 linux 系统的应用程序的网络连接信息,每个进程打开的 tcp 套接字,本地及远程的 ip 都包含在内,基于它,你可以进行如下的图分析:

- 收集Prometheus导出的指标,从5.2开始,监控系统普罗米修斯的收集模块导出的数据可以提供给 Metricbeat 然后索引进 Elasticsearch。

对话 Kibana 之父:如果需要,你应该自己动手编写工具

资讯动态 • medcl 发表了文章 • 2 个评论 • 8862 次浏览 • 2017-01-11 11:45

如果你有一个想法,把它code出来,build起来。不要等其他人的开源代码,有可能你会等到,但是有可能你永远等不到。在你写出来之后,你没准会收获惊喜。

Elastic Stack 5.0 正式发布

资讯动态 • medcl 发表了文章 • 0 个评论 • 7473 次浏览 • 2016-10-27 16:28

- [Elasticsearch](https://www.elastic.co/blog/el ... eased )

- [Kibana](https://www.elastic.co/blog/kibana-5-0-0 )

- [Logstash](https://www.elastic.co/blog/lo ... eased )

- Kibana里的管理和监控的UI界面

- Kibana里创建用户和角色的UI界面

- 非常简化的安装流程

- [Elasticsearch 5.0.0 下载](https://www.elastic.co/downloads/elasticsearch )

- [Kibana 5.0.0 下载](https://www.elastic.co/downloads/kibana )

- [X-Pack 5.0.0 安装指南](https://www.elastic.co/downloads/x-pack )

- [Logstash 5.0.0 下载](https://www.elastic.co/downloads/logstash )

- [Beats 5.0.0 下载](https://www.elastic.co/downloads/beats )

- [ES-Hadoop 5.0.0 下载](https://www.elastic.co/downloads/hadoop )

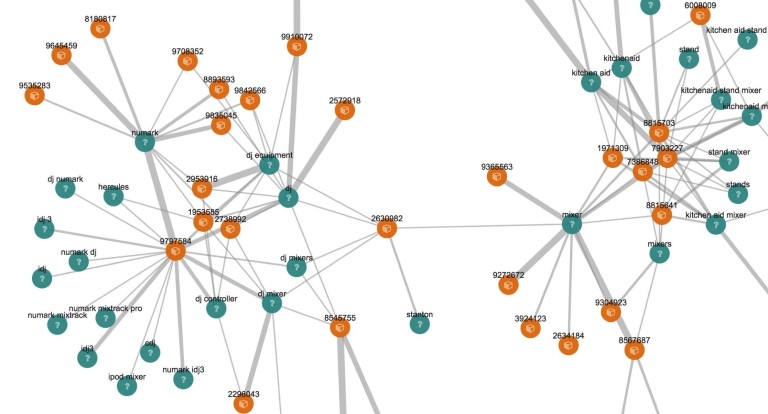

Elastic 为 Elastic Stack 带来新的 Graph 实时图分析功能

资讯动态 • medcl 发表了文章 • 1 个评论 • 14329 次浏览 • 2016-03-31 09:36

【杭州站】Elastic & 阿里云 Meetup 6月5号

活动 • liaosy 发表了文章 • 0 个评论 • 2646 次浏览 • 2021-05-22 17:38

活动介绍

本次Meetup杭州站由阿里云和Elastic联合举办,邀请来自滴滴、安恒信息、阿里云的资深技术专家探讨在搜索、安全、内核优化等方向的实践与创新,以及发布由数十位优秀技术开发者共创而成的实战指南,共同分享 Elasticsearch技术大咖的一线经验与深度思考。

报名方式

链接:https://www.bagevent.com/event/7449056

扫码:

活动时间

2021年06月05日 13:00-17:30

活动地址

浙江省杭州市余杭区阿里巴巴西溪园区访客中心 206-S越秀书院

活动流程

13:00~13:15 签到入座

13:15~13:30 开发者共创书籍《Elastic Stack 实战手册V1.0》发布

13:30~14:30 滴滴Elasticsearch内核优化之路

韩宝君 滴滴Elasticsearch资深开发工程师/ES社区Contributor

14:30~15:30 Elasticsearch在SIEM的应用与实践

汤乐奇 安恒信息AiLPHA大数据资深研发经理

15:30~16:30 Elasticsearch Serverless 云原生时代的创新实践

马华标(城破) 阿里巴巴高级技术专家/阿里云ES内核研发负责人

16:30~17:20 圆桌交流

17:20~17:30 抽奖合影活动奖品

阿里云双肩包、T恤、Elastic定制礼物

阿里云ACE

阿里云ACE即全称 Alibaba Cloud Engineer,是意为阿里云的工程师、代表着云计算的建设者。同时“ACE”又是扑克牌中的“A”,因此阿里云ACE也寓意着是云计算领域王牌的一群人。在线上,ACE拥有专属的页面和29个社群,承载论坛及专栏等内容; 在线下,ACE通过组织丰富的活动,包括技术沙龙、TechDay、Meetup、官方互动等来形成本地化的开发者的学习、社交平台。

通过ACE组织的各种活动,ACE用户可以结识本地的开发者,收获前沿知识,积累行业经验,并加深对阿里云的了解。

活动交流及杭州ACE同城会钉群

活动海报

2021 Elastic 中文社区深圳线下 Meetup 重磅重启,讲师招募进行中!

活动 • howardhuang 发表了文章 • 0 个评论 • 2639 次浏览 • 2021-05-21 15:49

使用 Elastic Stack 来监控和调优 Golang 应用程序

Beats • medcl 发表了文章 • 0 个评论 • 11567 次浏览 • 2017-03-03 11:16

- Apache Module

- Couchbase Module

- Docker Module

- HAProxy Module

- kafka Module

- MongoDB Module

- MySQL Module

- Nginx Module

- PostgreSQL Module

- Prometheus Module

- Redis Module

- System Module

- ZooKeeper Module

import _ "expvar"func metricsHandler(w http.ResponseWriter, r *http.Request) {

w.Header().Set("Content-Type", "application/json; charset=utf-8")

first := true

report := func(key string, value interface{}) {

if !first {

fmt.Fprintf(w, ",\n")

}

first = false

if str, ok := value.(string); ok {

fmt.Fprintf(w, "%q: %q", key, str)

} else {

fmt.Fprintf(w, "%q: %v", key, value)

}

}

fmt.Fprintf(w, "{\n")

expvar.Do(func(kv expvar.KeyValue) {

report(kv.Key, kv.Value)

})

fmt.Fprintf(w, "\n}\n")

}

func main() {

mux := http.NewServeMux()

mux.HandleFunc("/debug/vars", metricsHandler)

endpoint := http.ListenAndServe("localhost:6060", mux)

}metricbeat.modules:

- module: golang

metricsets: ["heap"]

enabled: true

period: 10s

hosts: ["localhost:6060"]

heap.path: "/debug/vars"output.elasticsearch:

hosts: ["localhost:9200"]./metricbeat -e -vvar inerInt int64 = 1024

pubInt := expvar.NewInt("your_metric_key")

pubInt.Set(inerInt)

pubInt.Add(2)./metricbeat -httpprof="127.0.0.1:6060" -e -v{

"output.events.acked": 1088,

"output.write.bytes": 1027455,

"output.write.errors": 0,

"output.messages.dropped": 0,

"output.elasticsearch.publishEvents.call.count": 24,

"output.elasticsearch.read.bytes": 12215,

"output.elasticsearch.read.errors": 0,

"output.elasticsearch.write.bytes": 1027455,

"output.elasticsearch.write.errors": 0,

"output.elasticsearch.events.acked": 1088,

"output.elasticsearch.events.not_acked": 0,

"output.kafka.events.acked": 0,

"output.kafka.events.not_acked": 0,

"output.kafka.publishEvents.call.count": 0,

"output.logstash.write.errors": 0,

"output.logstash.write.bytes": 0,

"output.logstash.events.acked": 0,

"output.logstash.events.not_acked": 0,

"output.logstash.publishEvents.call.count": 0,

"output.logstash.read.bytes": 0,

"output.logstash.read.errors": 0,

"output.redis.events.acked": 0,

"output.redis.events.not_acked": 0,

"output.redis.read.bytes": 0,

"output.redis.read.errors": 0,

"output.redis.write.bytes": 0,

"output.redis.write.errors": 0,

"beat.memstats.memory_total": 155721720,

"beat.memstats.memory_alloc": 3632728,

"beat.memstats.gc_next": 6052800,

"cmdline": ["./metricbeat","-httpprof=127.0.0.1:6060","-e","-v"],

"fetches": {"system-cpu": {"events": 4, "failures": 0, "success": 4}, "system-filesystem": {"events": 20, "failures": 0, "success": 4}, "system-fsstat": {"events": 4, "failures": 0, "success": 4}, "system-load": {"events": 4, "failures": 0, "success": 4}, "system-memory": {"events": 4, "failures": 0, "success": 4}, "system-network": {"events": 44, "failures": 0, "success": 4}, "system-process": {"events": 1008, "failures": 0, "success": 4}},

"libbeat.config.module.running": 0,

"libbeat.config.module.starts": 0,

"libbeat.config.module.stops": 0,

"libbeat.config.reloads": 0,

"memstats": {"Alloc":3637704,"TotalAlloc":155

... ...- module: golang

metricsets: ["heap","expvar"]

enabled: true

period: 1s

hosts: ["localhost:6060"]

heap.path: "/debug/vars"

expvar:

namespace: "metricbeat"

path: "/debug/vars".es("metricbeat*",metric="max:golang.metricbeat.output.elasticsearch.events.acked").derivative().label("Elasticsearch Success"),.es("metricbeat*",metric="max:golang.metricbeat.output.elasticsearch.events.not_acked").derivative().label("Elasticsearch Failed")对话 Kibana 之父:如果需要,你应该自己动手编写工具

资讯动态 • medcl 发表了文章 • 2 个评论 • 8862 次浏览 • 2017-01-11 11:45

如果你有一个想法,把它code出来,build起来。不要等其他人的开源代码,有可能你会等到,但是有可能你永远等不到。在你写出来之后,你没准会收获惊喜。

Docker如何快速构建Elastic Stack

回复Elasticsearch • zqc0512 回复了问题 • 3 人关注 • 2 个回复 • 2444 次浏览 • 2019-01-17 11:40

【杭州站】Elastic & 阿里云 Meetup 6月5号

活动 • liaosy 发表了文章 • 0 个评论 • 2646 次浏览 • 2021-05-22 17:38

活动介绍

本次Meetup杭州站由阿里云和Elastic联合举办,邀请来自滴滴、安恒信息、阿里云的资深技术专家探讨在搜索、安全、内核优化等方向的实践与创新,以及发布由数十位优秀技术开发者共创而成的实战指南,共同分享 Elasticsearch技术大咖的一线经验与深度思考。

报名方式

链接:https://www.bagevent.com/event/7449056

扫码:

活动时间

2021年06月05日 13:00-17:30

活动地址

浙江省杭州市余杭区阿里巴巴西溪园区访客中心 206-S越秀书院

活动流程

13:00~13:15 签到入座

13:15~13:30 开发者共创书籍《Elastic Stack 实战手册V1.0》发布

13:30~14:30 滴滴Elasticsearch内核优化之路

韩宝君 滴滴Elasticsearch资深开发工程师/ES社区Contributor

14:30~15:30 Elasticsearch在SIEM的应用与实践

汤乐奇 安恒信息AiLPHA大数据资深研发经理

15:30~16:30 Elasticsearch Serverless 云原生时代的创新实践

马华标(城破) 阿里巴巴高级技术专家/阿里云ES内核研发负责人

16:30~17:20 圆桌交流

17:20~17:30 抽奖合影活动奖品

阿里云双肩包、T恤、Elastic定制礼物

阿里云ACE

阿里云ACE即全称 Alibaba Cloud Engineer,是意为阿里云的工程师、代表着云计算的建设者。同时“ACE”又是扑克牌中的“A”,因此阿里云ACE也寓意着是云计算领域王牌的一群人。在线上,ACE拥有专属的页面和29个社群,承载论坛及专栏等内容; 在线下,ACE通过组织丰富的活动,包括技术沙龙、TechDay、Meetup、官方互动等来形成本地化的开发者的学习、社交平台。

通过ACE组织的各种活动,ACE用户可以结识本地的开发者,收获前沿知识,积累行业经验,并加深对阿里云的了解。

活动交流及杭州ACE同城会钉群

活动海报

2021 Elastic 中文社区深圳线下 Meetup 重磅重启,讲师招募进行中!

活动 • howardhuang 发表了文章 • 0 个评论 • 2639 次浏览 • 2021-05-21 15:49

访谈:Elastic Stack v6.5 新特性解读

Podcast • medcl 发表了文章 • 0 个评论 • 3038 次浏览 • 2018-11-25 21:23

欢迎来到 Elastic 社区电台的第八期节目,我们本期节目的嘉宾是来自于Elastic 在中国的首席架构师吴斌, Elastic 在本月11月14日发布了一个全新的版本 6.5,放出了一系列精彩的特性,本次节目我们就这些最近发布的新特性做一个简单的解读。

收听地址

https://www.ximalaya.com/keji/14965410/139462151

嘉宾

吴斌,十年 IT 行业经验,经历了软件工程师到架构师的全方位磨练。专注于海量数据处理、挖掘、分析和企业级搜索等领域。 现任 Elastic 架构师,负责公司亚太地区事务。致力于应用 Elastic 的先进技术产品解决企业数据应用问题。

主持人

Elastic 技术布道师,曾勇(Medcl)。

关于 Elastic 社区电台

Elastic 开源社区举办的一款播客类节目, 邀请来自开源社区的用户,一起聊聊 Elastic 开源产品的使用案例、经验分享、架构变迁等等。

Elastic Stack 6.0 发布 beta 版本啦!

资讯动态 • medcl 发表了文章 • 11 个评论 • 5965 次浏览 • 2017-08-09 10:29

- Sequence numbers and fast recovery

- Search scalability

- Preventing full disks

- Removal of default passwords

- 优化 Profiling 的开销占用,进一步较少针对超时及查询取消的检查开销

- 提升 Percolator 的性能

- Upgrade Assistant and Rolling Upgrade Support

- Watcher UI for Threshold Based Alerts

- Experimental Kibana Query Language

- Refactoring of the Visualizations Code

- X-Pack Monitoring Email Notifications for Cluster Alerts

- Cluster Alert for X-Pack License Expiration

- New Colors to Improve Accessibility

- Full Screen Mode for Dashboard

- Pipeline Viewer

- Centrally manage configurations

- Ingest to Logstash convertor

$LS_HOME/bin/ingest-convert.sh --input file:///tmp/ingest/apache.json --output file:///tmp/ingest/apache.conf

- Auditbeat

- New commands and configuration layout

$ metricbeat modules list

$ metricbeat modules enable redis

$ metricbeat modules disable redis- Add Docker metadata to the Docker logs

- Internal pipeline refactoring

- Spark 2.2.0 and Stable Support for Spark Structured Streaming

- Support for new Join Fields

- Multiple Mappings and Multiple Index Reads

使用 Elastic Stack 来监控和调优 Golang 应用程序

Beats • medcl 发表了文章 • 0 个评论 • 11567 次浏览 • 2017-03-03 11:16

- Apache Module

- Couchbase Module

- Docker Module

- HAProxy Module

- kafka Module

- MongoDB Module

- MySQL Module

- Nginx Module

- PostgreSQL Module

- Prometheus Module

- Redis Module

- System Module

- ZooKeeper Module

import _ "expvar"func metricsHandler(w http.ResponseWriter, r *http.Request) {

w.Header().Set("Content-Type", "application/json; charset=utf-8")

first := true

report := func(key string, value interface{}) {

if !first {

fmt.Fprintf(w, ",\n")

}

first = false

if str, ok := value.(string); ok {

fmt.Fprintf(w, "%q: %q", key, str)

} else {

fmt.Fprintf(w, "%q: %v", key, value)

}

}

fmt.Fprintf(w, "{\n")

expvar.Do(func(kv expvar.KeyValue) {

report(kv.Key, kv.Value)

})

fmt.Fprintf(w, "\n}\n")

}

func main() {

mux := http.NewServeMux()

mux.HandleFunc("/debug/vars", metricsHandler)

endpoint := http.ListenAndServe("localhost:6060", mux)

}metricbeat.modules:

- module: golang

metricsets: ["heap"]

enabled: true

period: 10s

hosts: ["localhost:6060"]

heap.path: "/debug/vars"output.elasticsearch:

hosts: ["localhost:9200"]./metricbeat -e -vvar inerInt int64 = 1024

pubInt := expvar.NewInt("your_metric_key")

pubInt.Set(inerInt)

pubInt.Add(2)./metricbeat -httpprof="127.0.0.1:6060" -e -v{

"output.events.acked": 1088,

"output.write.bytes": 1027455,

"output.write.errors": 0,

"output.messages.dropped": 0,

"output.elasticsearch.publishEvents.call.count": 24,

"output.elasticsearch.read.bytes": 12215,

"output.elasticsearch.read.errors": 0,

"output.elasticsearch.write.bytes": 1027455,

"output.elasticsearch.write.errors": 0,

"output.elasticsearch.events.acked": 1088,

"output.elasticsearch.events.not_acked": 0,

"output.kafka.events.acked": 0,

"output.kafka.events.not_acked": 0,

"output.kafka.publishEvents.call.count": 0,

"output.logstash.write.errors": 0,

"output.logstash.write.bytes": 0,

"output.logstash.events.acked": 0,

"output.logstash.events.not_acked": 0,

"output.logstash.publishEvents.call.count": 0,

"output.logstash.read.bytes": 0,

"output.logstash.read.errors": 0,

"output.redis.events.acked": 0,

"output.redis.events.not_acked": 0,

"output.redis.read.bytes": 0,

"output.redis.read.errors": 0,

"output.redis.write.bytes": 0,

"output.redis.write.errors": 0,

"beat.memstats.memory_total": 155721720,

"beat.memstats.memory_alloc": 3632728,

"beat.memstats.gc_next": 6052800,

"cmdline": ["./metricbeat","-httpprof=127.0.0.1:6060","-e","-v"],

"fetches": {"system-cpu": {"events": 4, "failures": 0, "success": 4}, "system-filesystem": {"events": 20, "failures": 0, "success": 4}, "system-fsstat": {"events": 4, "failures": 0, "success": 4}, "system-load": {"events": 4, "failures": 0, "success": 4}, "system-memory": {"events": 4, "failures": 0, "success": 4}, "system-network": {"events": 44, "failures": 0, "success": 4}, "system-process": {"events": 1008, "failures": 0, "success": 4}},

"libbeat.config.module.running": 0,

"libbeat.config.module.starts": 0,

"libbeat.config.module.stops": 0,

"libbeat.config.reloads": 0,

"memstats": {"Alloc":3637704,"TotalAlloc":155

... ...- module: golang

metricsets: ["heap","expvar"]

enabled: true

period: 1s

hosts: ["localhost:6060"]

heap.path: "/debug/vars"

expvar:

namespace: "metricbeat"

path: "/debug/vars".es("metricbeat*",metric="max:golang.metricbeat.output.elasticsearch.events.acked").derivative().label("Elasticsearch Success"),.es("metricbeat*",metric="max:golang.metricbeat.output.elasticsearch.events.not_acked").derivative().label("Elasticsearch Failed")Elastic Stack 5.2.2 发布

资讯动态 • medcl 发表了文章 • 5 个评论 • 3373 次浏览 • 2017-03-01 10:37

- 修复request熔断器没有正确处理当前运行请求数的bug,当请求返回前却被客户端关闭时没有对计数减一,会造成节点慢慢的不能处理任何请求,除非重启节点,所有的用户都应该升级 #23317

- 修复cgroup正则解析的bug,造成节点的不能正常启动 #23219

- 被shard锁暂缓执行的请求可能会别其他线程启动,并且该请求丢失了上下文,会造成该请求被当做非法请求而拒绝

- 恢复terms agg的include/exclude参数的支持

- 修复持久化队列在windows启用造成的崩溃

- 修复多实例公用相同的数据目录造成的数据损坏

- 修复JVM性能指标收集造成的吞吐影响

- 之前的版本kibana的visualization依赖一个旧的Elasticsearch的include/exclude特性,但是该功能在Elasticsearch5.2.1被突然移除了,引起了kibana的visualization的错误,现在Kibana对新创建的visualization使用正确的结构,并且能在查询时自动转换遗留的旧结构到新的结构

- 从5.2.0开始,包含sub-bucket的垂直条形图(vertical bar)配置为分组没有合适的缩减y轴,造成相当小甚至某些情况下不可用,这次回归将再次对y轴进行必要的扩展而不管其条形图的模式

- Metricbeat修复当docker容器被kill掉造成的docker 模块挂起的bug

- Metricbeat修复超时时间设置而不是默认值

Elastic Stack 5.2.1 发布

资讯动态 • medcl 发表了文章 • 4 个评论 • 5529 次浏览 • 2017-02-15 14:07

- 当存储字段配置为“best_compression",我们依赖于 JVM 回收机制来释放解压缩实例(Deflater/Inflater instances)。然而这些类也行只使用了很少的 JVM 堆栈内存,却使用了大量了本地内存,所以可能 会出现在 JVM 回收解压缩实例之前而操作系统先用完了本地内存。 LUCENE-7647。

- 特定的查询可能会持有 IndexReader 的一个引用,当这些查询被缓存之后,本来应该已经被删除的段会因为这个引用而继续被 Lucene 持有。LUCENE-7657。

- Geo distance range 废弃,请使用`geo_distance` bucket aggregation 或 geo_distance sort来替代。#22835。

- 分配解释 API(allocation explaining)在未分配主分片信息中包含陈旧的副本信息(不管是陈旧还是损坏的)#22826。

- 如果查询超时,将缓存结果置为无效。#22807。

- Reindex 接口支持来源 es 版本<2.0,当不能清除旧的 scroll 不记录日志。

- 将参数:search.highlight.term_vector_multi_value 保留为节点级别。

Elastic Stack 5.2.0 发布

资讯动态 • medcl 发表了文章 • 1 个评论 • 6988 次浏览 • 2017-02-03 13:26

- 新增数字和日期范围字段类型,非常方便对范围类型进行交并集的查询,比如你的数据是日历类型的数据,每天都有一些会议信息,会议的开始和结束时间都不同,你想看本周那天有空,可以使用 range fields 很方便的进行查询。了解更多

- 新增分片分配解释 API,会告知分片失败的具体原因,如分片损坏、磁盘写满还是配置错误,进行快速运维,以前只能根据经验到处寻找可能是什么问题,费事费力,了解更多。

- 对 Keyword 类型标准化,在5.0将 string 类型拆成了 text 和 keyword两种类型,text 支持分词,keyword 则不分词默认支持 doc values,不过有时候你还需要对 keyword 类型进行一些标准化处理,如都转成小写,现在可以使用 normalizers 参数来指定标准化的 filter。

- Terms 聚合的分区,terms 聚合默认返回10个 term,以前如果你需要返回全部的 term 列表是不可能的任务(基于内存压力),现在你可以通过将请求分区,以多次请求的方式来取回这些数据,了解更多。

- 字段折叠,在搜索时可以按某个字段的值进行折叠,在每个折叠的值内进行排序选取 topN,了解更多。

- 新的监控 UI,现在 X-Pack 也能监控 logstash 了,X-Pack 基础免费版就包括,如下图:

- 更多的监控 API,新增3个类型的统计信息:cgroup、持久化队列和 output新增持续时间字段。

- 离线插件管理,在很多没有公网的部署环境,都需要离线安装,以前的离线安装不够完善,尽管大部分插件没问题,但是还是存在个别插件的依赖链下载不完整的问题,为了解决这个问题,我们基本上重新设计了整个工作流程使用了新的方式来打包插件和他所有的依赖,了解更多。

- 支持 Elasticsearch Tribe 节点,在“admin”集群的基础上,引入了新的“data”集群,“data”集群可以理解成 Kibana 后面的数据来源,可以是 tribe 节点,而“admin”集群是存放 kibana 可视化信息“。kibana”索引的地方,默认 data 和 admin 集群都是在同一个集群,且不能是 tribe 节点,目前还有一些细节正在处理,如 console 还不能很好的工作。

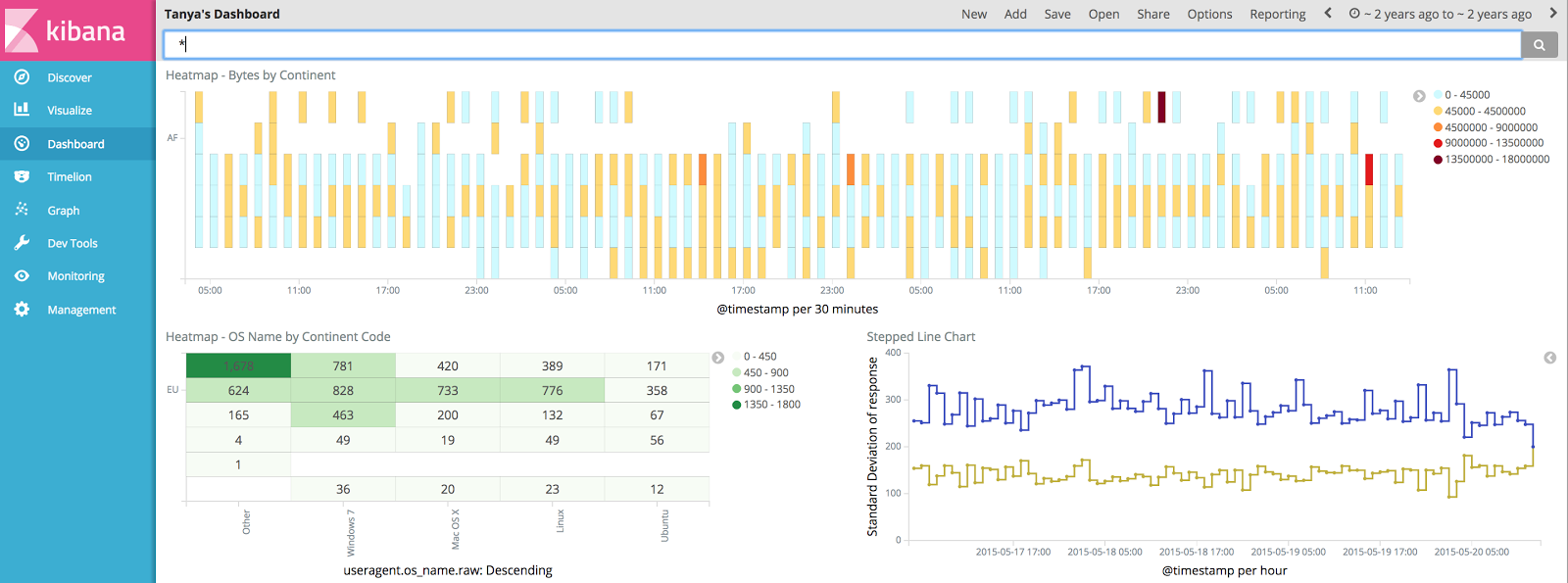

- 增加新的可视化类型:热点图(heatmap),可以很方便的按区间和按时间来显示数据的范围分布,如下图:

- 开始进行国际化的支持,感谢 IBM 团队的努力,目前已经提供了基础的框架支持,虽然是万里长征的第一大步,但也是非常激动人心的。

- 地图服务的改进,Elastic 自己的 Tile 地图服务已经上线几个月了,我们现在能提供10个级别的缩放了,X-Pack 基础用户可以达到12个级别的缩放,并且我们正在尝试18个级别的缩放,并且从5.2开始,我们能让这些级别动态调整,不用发布新的 Kibana。

- 监控容器中的 Elasticsearch,现在我们可以监控容器里面的 Elasticsearch 实例的运行情况了,CPU 利用率、GC、堆栈使用情况等,如下图:

- 新增 Beat:Heartbeat,一个新的正式的官方beat 成员,用于可用性监控,和所有的 beat 一样,轻量级,Heartbeat 可以用于很多场景,比如安全,你不希望暴露某个端口时,使用 Heartbeat,当你发现该端口对外开启了,就可以触发通知,或者服务/网站可用性检测,服务down 了可以及时感知,目前支持:ICMP、TCP 和 HTTP 类型的监控,目前 Heartbeat还处于 beat 阶段,暂不推荐用于生产环境。

- Metricbeat 可跟踪网络连接,从5.2开始,Metricbeat 导出了 linux 系统的应用程序的网络连接信息,每个进程打开的 tcp 套接字,本地及远程的 ip 都包含在内,基于它,你可以进行如下的图分析:

- 收集Prometheus导出的指标,从5.2开始,监控系统普罗米修斯的收集模块导出的数据可以提供给 Metricbeat 然后索引进 Elasticsearch。

对话 Kibana 之父:如果需要,你应该自己动手编写工具

资讯动态 • medcl 发表了文章 • 2 个评论 • 8862 次浏览 • 2017-01-11 11:45

如果你有一个想法,把它code出来,build起来。不要等其他人的开源代码,有可能你会等到,但是有可能你永远等不到。在你写出来之后,你没准会收获惊喜。

Elastic Stack 5.0 正式发布

资讯动态 • medcl 发表了文章 • 0 个评论 • 7473 次浏览 • 2016-10-27 16:28

- [Elasticsearch](https://www.elastic.co/blog/el ... eased )

- [Kibana](https://www.elastic.co/blog/kibana-5-0-0 )

- [Logstash](https://www.elastic.co/blog/lo ... eased )

- Kibana里的管理和监控的UI界面

- Kibana里创建用户和角色的UI界面

- 非常简化的安装流程

- [Elasticsearch 5.0.0 下载](https://www.elastic.co/downloads/elasticsearch )

- [Kibana 5.0.0 下载](https://www.elastic.co/downloads/kibana )

- [X-Pack 5.0.0 安装指南](https://www.elastic.co/downloads/x-pack )

- [Logstash 5.0.0 下载](https://www.elastic.co/downloads/logstash )

- [Beats 5.0.0 下载](https://www.elastic.co/downloads/beats )

- [ES-Hadoop 5.0.0 下载](https://www.elastic.co/downloads/hadoop )

Elastic 为 Elastic Stack 带来新的 Graph 实时图分析功能

资讯动态 • medcl 发表了文章 • 1 个评论 • 14329 次浏览 • 2016-03-31 09:36